AI 驅動的內容生成如今已深度融入 Adobe、Canva 等熱門工具,許多機構與工作室也已將該技術納入工作流程。當前圖像模型已能穩定輸出逼真的寫實效果,影片模型則可生成更長、更具連貫性的畫面內容,同時兩者都能遵循創作指令進行生成。

越來越多創作者選擇在本地 PC 上運行這些工作流程,藉此更好的掌握創作素材、節省雲端服務成本,並降低反覆修改帶來的阻礙,從而更高效地最佳化生成結果,滿足創意專案的製作時程需求,請參考影片。

一直以來,NVIDIA RTX PC 透過強大的效能成為運行創意 AI 的首選平台,不僅大幅縮短反覆運算時間,也讓使用者免費在本地運行模型,徹底消除了對 Token 消耗的顧慮。

本月稍早在 CES 上發布的 RTX 最佳化與全新開放模型,也讓創作者能以更快的速度、更高效率進行創作,並獲得遠超以往的創意呈現。

如何開始

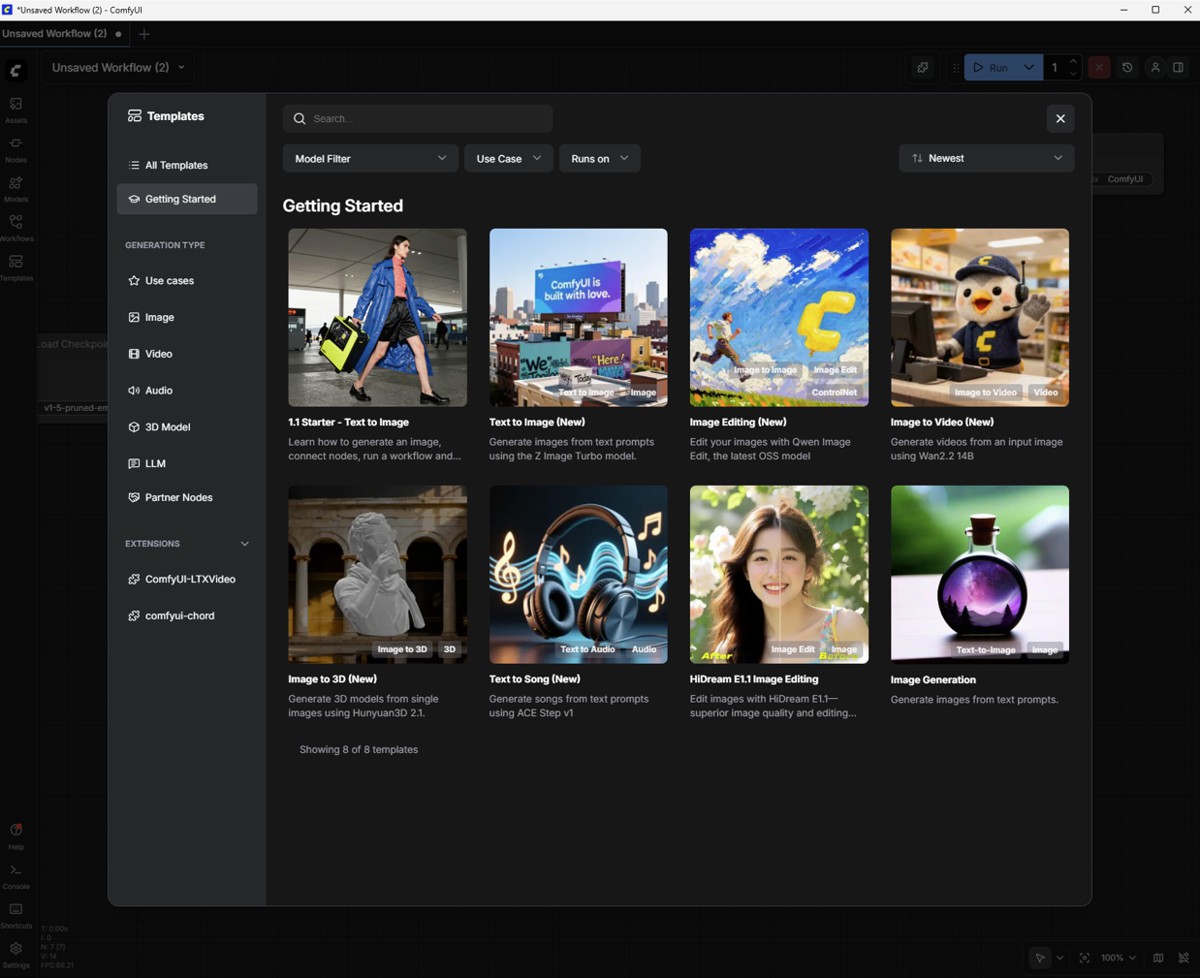

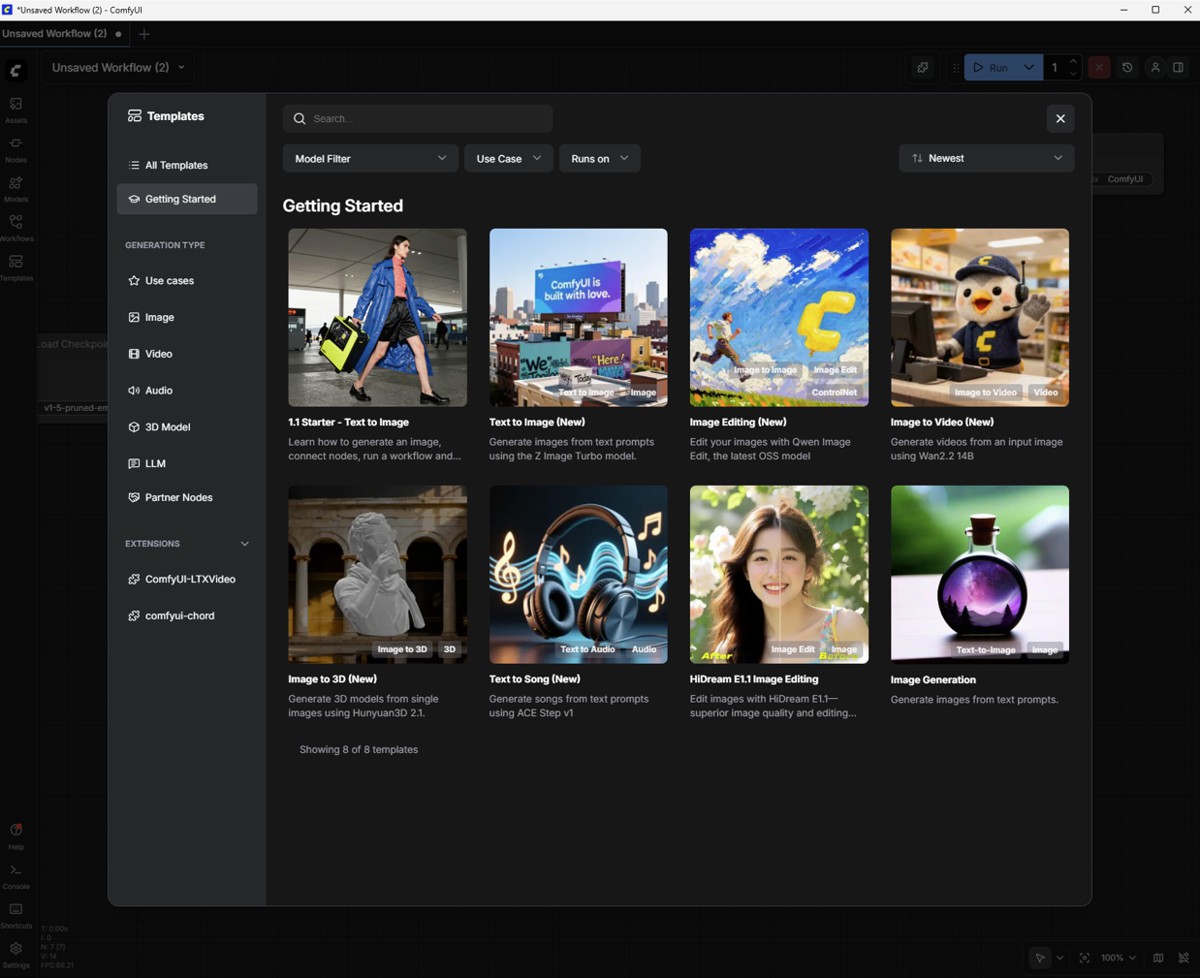

視覺生成式 AI 可能會讓新使用者感覺複雜,且有諸多限制。線上AI生成工具雖然使用簡單,但可控性有限。ComfyUI 這樣的開源社群工具,簡化了進階創意工作流程的搭建,且安裝便捷。同時,它們也提供了取得最新、強大的模型,如 FLUX.2 和 LTX-2,以及優秀社群工作流程的簡單途徑。

以下是如何在 RTX PC 上使用 ComfyUI 和主流模型,以視覺生成式 AI 進行本地創作的方法:

修改提示詞並再次運行,即可進一步深入探索視覺生成式AI的創作世界。

接下來將介紹如何進一步使用更多 ComfyUI 範本,體驗採用更進階的圖像與影片模型的創作流。

模型規模與 GPU

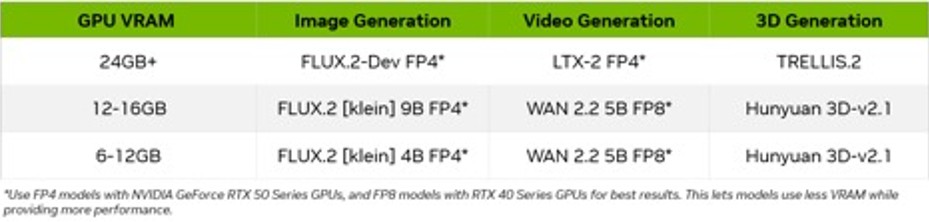

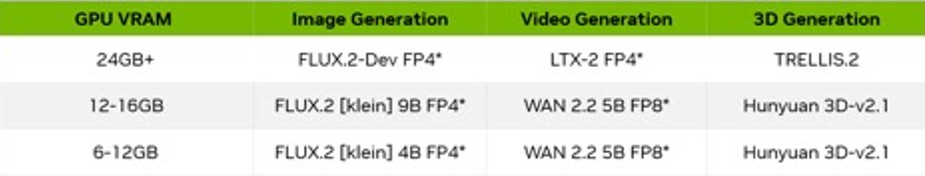

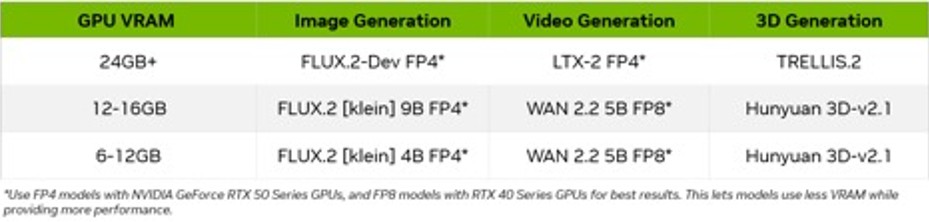

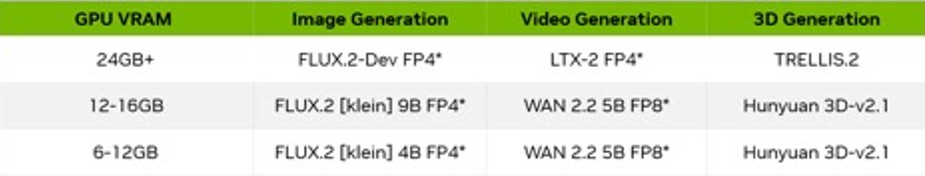

當使用者逐漸熟悉 ComfyUI 及其支援的模型後,就需要開始考慮GPU VRAM 使用量,以及特定模型是否能夠在範圍內運行。以下提供依不同 GPU VRAM的入門範例:

生成圖像

探索如何使用 FLUX.2-Dev 提升圖像生成品質,在 ComfyUI 的「範本」部分,點擊「所有範本」,並搜尋「FLUX.2 Dev 文生圖」。選擇後,ComfyUI 將載入一組已連接的節點,也就是「工作流程」。

FLUX.2-Dev 包含需要下載的模型權重。模型權重是 AI 模型內部所包含的「知識」,可將其理解為大腦中的突觸。當像 FLUX.2 這樣的圖像生成模型被訓練時,它會從數百萬張圖像中學習模式,而這些模式會以數十億個數值的形式被儲存下來,這些數值就稱為「權重」。

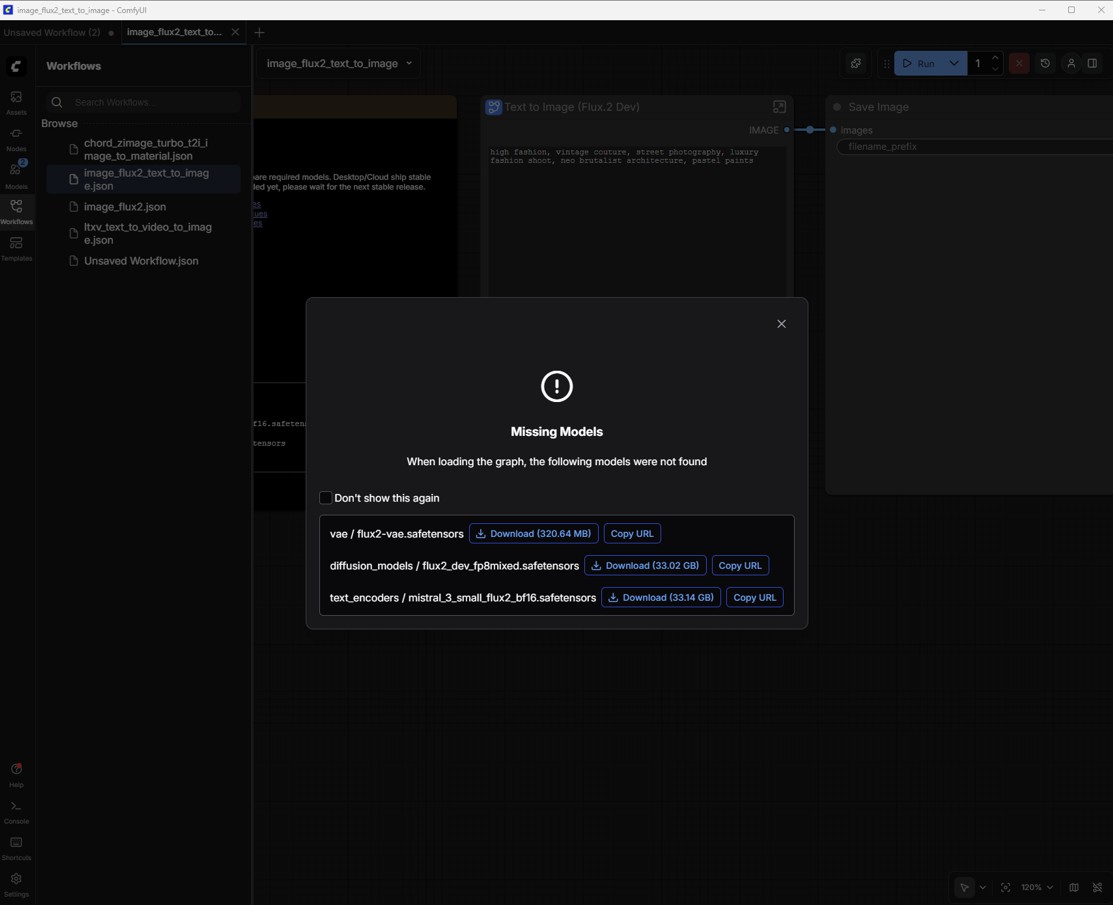

ComfyUI 並未內建這些權重檔,而是在需要時,從 Hugging Face 等資料庫中按需下載。由於檔案通常很大,FLUX.2 根據版本不同,大小可能超過 30GB,因此系統需要具備足夠的儲存空間,並預留相應的下載時間。

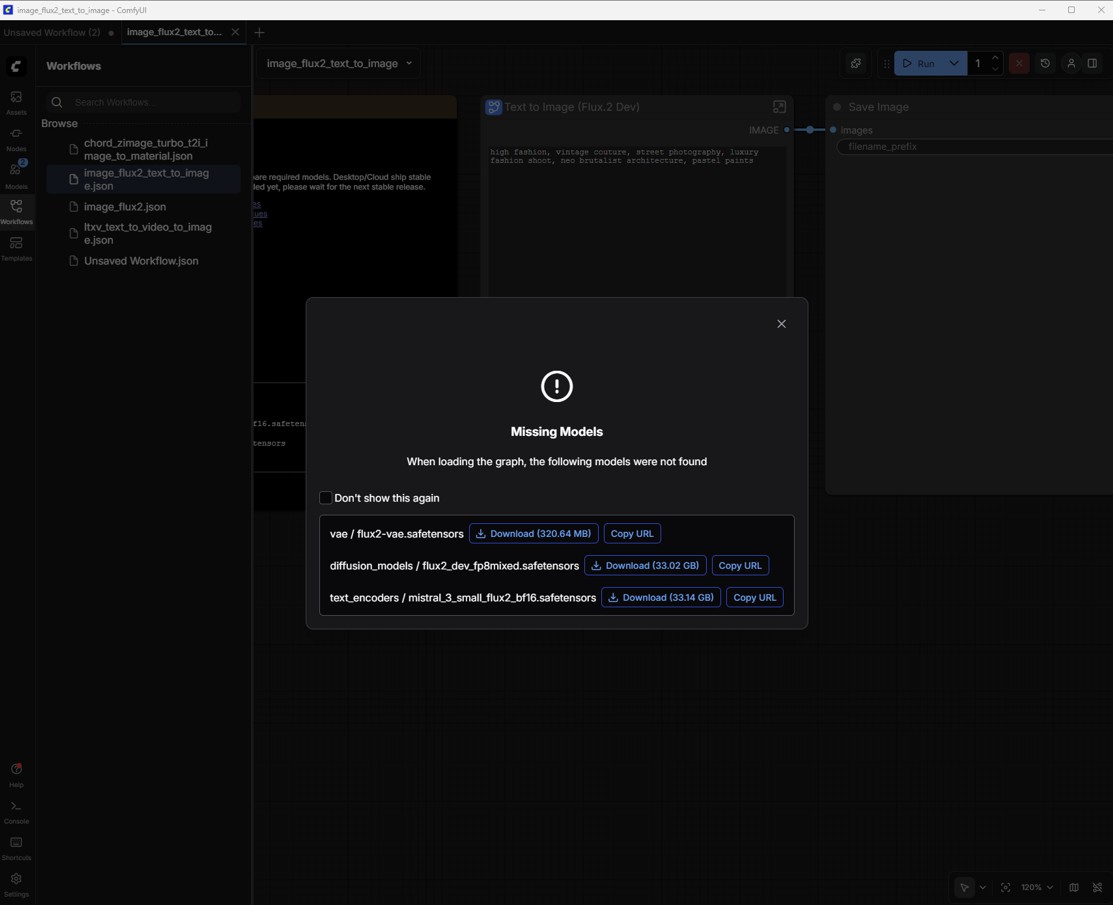

系統會彈出一個對話方塊,引導使用者下載模型權重。權重檔(filename.safetensors)會自動儲存儲存到使用者 PC 上 ComfyUI 對應的正確資料夾中。

儲存工作流程

模型權重下載完成後,下一步是將這個新下載的範本儲存為一個「工作流」。

點擊左上角的漢堡功能表(三條橫線),選擇「儲存」。該工作流將被儲存到使用者的「工作流程」清單中(按下 W 鍵可顯示或隱藏該視窗)。隨後可關閉分頁,並在不丟失任何內容的情況下退出該工作流程。

若在模型權重尚未下載完成前,不小心關閉了下載對話方塊:

FLUX.2-Dev 提示詞技巧

從清晰、具體的主體、場景、風格和氛圍描述開始,例如:「電影感特寫,一輛雨中的復古賽車,濕漉漉的柏油路面上映出霓虹反射,高對比,35mm 攝影。」入門階段以簡短到中等長度的提示詞為佳,一到兩句的聚焦明確描述,通常比冗長、故事化的提示更容易控制效果。

可添加約束條件,以引導一致性和品質,例如:

盡量避免使用負面提示詞,改以清楚描述想呈現的內容為主。

請參考 Black Forest Labs 提供的指南,瞭解更多關於 FLUX.2 提示詞的使用技巧。

本機存放區路徑

完成圖像細化後,右鍵點擊「儲存圖像」節點,即可在瀏覽器中開啟圖像,或將其另儲存到其他位置。

依應用類型和作業系統不同,ComfyUI 的預設輸出資料夾通常如下:

影片生成

以全新的 LTX-2 模型為例,探索如何提升影片生成品質,請參考影片。

Lightrick 的 LTX-2 是一款先進的影音模型,專為在 ComfyUI 中實現可控、分鏡式的影片生成而設計。在下載完成 LTX-2 圖生影片範本及模型權重後,建議將提示詞視為簡短的鏡頭描述,而非完整的電影劇本。

與前兩個範本不同,LTX-2 圖生影片會結合一張圖像與文本提示詞來生成影片。

使用者可選用在 FLUX.2-Dev 中生成的其中一張圖像,再加入文本提示詞,讓畫面「動」起來。

LTX-2 提示詞技巧

為在 ComfyUI 中獲得最佳效果,建議將提示詞以現在式寫成一段連貫文字,或採用簡潔的腳本格式(包括場景標題、動作、角色名稱與對白)。整體以 4 到 6 句描述性語句為宜,並涵蓋所有關鍵要素:

最佳化 VRAM 使用量和圖像品質

作為前沿模型,LTX-2 為了提供高品質效果,通常需要佔用大量 VRAM。隨著解析度、畫格率、影片時長或採樣步數的提升,記憶體使用量也會隨之增加。

因此,ComfyUI 與 NVIDIA 合作最佳化了weight streaming 功能,當 GPU VRAM 不足時,可將工作流的部分內容卸載到系統記憶體中運行,不過相對地,效能也會下降。

依 GPU 型號和使用場景的不同,使用者可能需要對這些因素加以限制,以確保生成時間保持在合理範圍內。

LTX-2 雖然非常先進,但也和任何模型一樣,參數設定的微調都會對最終品質產生明顯影響。

若想瞭解如何在 RTX GPU 上最佳化 LTX-2,請參考用於 ComfyUI 的 LTX-2 快速入門指南。

使用 FLUX.2-Dev 與 LTX-2 建構自訂工作流程

若使用者需簡化在不同 ComfyUI 工作流之間來回切換,以及在本機尋找 FLUX.2-Dev 生成的圖片並插入 LTX-2 工作流中的過程,可將 FLUX.2-Dev 與 LTX-2 組合到一個新的工作流程中:

進階 3D 生成

在使用 FLUX.2 生成圖像,並以 LTX-2 生成影片之後,下一步便是加入 3D 引導。NVIDIA 的 3D 引導生成式 AI Blueprint 示範了如何利用 3D 場景與資產,在 RTX PC 上打造更可控、面向專業製作流程的圖像與影片管線,並提供現成的工作流,供使用者查看、調整和擴充。

此外,創作者也可以在 Stable Diffusion subreddit 和 ComfyUI Discord 上展示作品、與其他使用者交流,並取得幫助。

別錯過 : NVIDIA RTX AI PC 的最新進展

越來越多創作者選擇在本地 PC 上運行這些工作流程,藉此更好的掌握創作素材、節省雲端服務成本,並降低反覆修改帶來的阻礙,從而更高效地最佳化生成結果,滿足創意專案的製作時程需求,請參考影片。

一直以來,NVIDIA RTX PC 透過強大的效能成為運行創意 AI 的首選平台,不僅大幅縮短反覆運算時間,也讓使用者免費在本地運行模型,徹底消除了對 Token 消耗的顧慮。

本月稍早在 CES 上發布的 RTX 最佳化與全新開放模型,也讓創作者能以更快的速度、更高效率進行創作,並獲得遠超以往的創意呈現。

如何開始

視覺生成式 AI 可能會讓新使用者感覺複雜,且有諸多限制。線上AI生成工具雖然使用簡單,但可控性有限。ComfyUI 這樣的開源社群工具,簡化了進階創意工作流程的搭建,且安裝便捷。同時,它們也提供了取得最新、強大的模型,如 FLUX.2 和 LTX-2,以及優秀社群工作流程的簡單途徑。

以下是如何在 RTX PC 上使用 ComfyUI 和主流模型,以視覺生成式 AI 進行本地創作的方法:

- 造訪comfy.org,下載並安裝適用於 Windows 的 ComfyUI。

- 啟動ComfyUI。

- 使用入門範本創建第一張圖像:

- 點擊「範本」按鈕,然後選擇「快速開始」,再選擇「文字轉圖片」。

- 將模型「節點」連接到「儲存圖像」節點。這些節點以流水線方式協同工作,並用AI生成內容。

- 點擊藍色的「運行」按鈕,觀察綠色「節點」高亮顯示,RTX PC 將開始生成你的第一張圖像。

接下來將介紹如何進一步使用更多 ComfyUI 範本,體驗採用更進階的圖像與影片模型的創作流。

模型規模與 GPU

當使用者逐漸熟悉 ComfyUI 及其支援的模型後,就需要開始考慮GPU VRAM 使用量,以及特定模型是否能夠在範圍內運行。以下提供依不同 GPU VRAM的入門範例:

[1] *為獲得最佳效果,建議在 NVIDIA GeForce RTX 50 系列 GPU 上使用 FP4 模型,在 RTX 40 系列 GPU 上使用 FP8 模型。這樣可在佔用更少顯存的同時,提供更高的效能表現。

[2] *為獲得最佳效果,建議在 NVIDIA GeForce RTX 50 系列 GPU 上使用 FP4 模型,在 RTX 40 系列 GPU 上使用 FP8 模型。這樣可在佔用更少顯存的同時,提供更高效能表現。

生成圖像

探索如何使用 FLUX.2-Dev 提升圖像生成品質,在 ComfyUI 的「範本」部分,點擊「所有範本」,並搜尋「FLUX.2 Dev 文生圖」。選擇後,ComfyUI 將載入一組已連接的節點,也就是「工作流程」。

FLUX.2-Dev 包含需要下載的模型權重。模型權重是 AI 模型內部所包含的「知識」,可將其理解為大腦中的突觸。當像 FLUX.2 這樣的圖像生成模型被訓練時,它會從數百萬張圖像中學習模式,而這些模式會以數十億個數值的形式被儲存下來,這些數值就稱為「權重」。

ComfyUI 並未內建這些權重檔,而是在需要時,從 Hugging Face 等資料庫中按需下載。由於檔案通常很大,FLUX.2 根據版本不同,大小可能超過 30GB,因此系統需要具備足夠的儲存空間,並預留相應的下載時間。

系統會彈出一個對話方塊,引導使用者下載模型權重。權重檔(filename.safetensors)會自動儲存儲存到使用者 PC 上 ComfyUI 對應的正確資料夾中。

儲存工作流程

模型權重下載完成後,下一步是將這個新下載的範本儲存為一個「工作流」。

點擊左上角的漢堡功能表(三條橫線),選擇「儲存」。該工作流將被儲存到使用者的「工作流程」清單中(按下 W 鍵可顯示或隱藏該視窗)。隨後可關閉分頁,並在不丟失任何內容的情況下退出該工作流程。

若在模型權重尚未下載完成前,不小心關閉了下載對話方塊:

- 按下 W 鍵可快速開啟「工作流程」視窗。

- 選擇該工作流程,ComfyUI 將重新載入,並自動提示下載缺失的模型權重。

FLUX.2-Dev 提示詞技巧

從清晰、具體的主體、場景、風格和氛圍描述開始,例如:「電影感特寫,一輛雨中的復古賽車,濕漉漉的柏油路面上映出霓虹反射,高對比,35mm 攝影。」入門階段以簡短到中等長度的提示詞為佳,一到兩句的聚焦明確描述,通常比冗長、故事化的提示更容易控制效果。

可添加約束條件,以引導一致性和品質,例如:

- 構圖(「廣角鏡頭」或「人像構圖」)

- 細節水準(「高細節,清晰對焦」)

- 寫實程度(「寫實風格」或「風格化插畫」)

盡量避免使用負面提示詞,改以清楚描述想呈現的內容為主。

請參考 Black Forest Labs 提供的指南,瞭解更多關於 FLUX.2 提示詞的使用技巧。

本機存放區路徑

完成圖像細化後,右鍵點擊「儲存圖像」節點,即可在瀏覽器中開啟圖像,或將其另儲存到其他位置。

依應用類型和作業系統不同,ComfyUI 的預設輸出資料夾通常如下:

- Windows(獨立版/可攜式版):通常位於C:\ComfyUI\output,或程式解壓目錄下的類似路徑。

- Windows(桌面版):路徑通常位於 AppData 目錄中,例如:C:\Users%username%\AppData\Local\Programs@comfyorgcomfyui-electron\resources\ComfyUI\output

- Linux:預設安裝路徑為~/.config/ComfyUI。

影片生成

以全新的 LTX-2 模型為例,探索如何提升影片生成品質,請參考影片。

Lightrick 的 LTX-2 是一款先進的影音模型,專為在 ComfyUI 中實現可控、分鏡式的影片生成而設計。在下載完成 LTX-2 圖生影片範本及模型權重後,建議將提示詞視為簡短的鏡頭描述,而非完整的電影劇本。

與前兩個範本不同,LTX-2 圖生影片會結合一張圖像與文本提示詞來生成影片。

使用者可選用在 FLUX.2-Dev 中生成的其中一張圖像,再加入文本提示詞,讓畫面「動」起來。

LTX-2 提示詞技巧

為在 ComfyUI 中獲得最佳效果,建議將提示詞以現在式寫成一段連貫文字,或採用簡潔的腳本格式(包括場景標題、動作、角色名稱與對白)。整體以 4 到 6 句描述性語句為宜,並涵蓋所有關鍵要素:

- 先確立鏡頭與場景(遠景/中景/特寫、光照、色彩、材質、氛圍)。

- 接著將動作描述為清晰的連續過程,定義角色可見特徵與肢體語言,並明確說明運鏡方式。

- 最後補充音訊元素,如環境音、音樂和對白,並以引號標注。

- 鏡頭運鏡語言:明確指定「緩慢推軌前進」、「手持跟拍」、「過肩鏡頭」、「橫向搖攝」、「向上俯仰」、「推進」、「拉遠」或「固定鏡頭」等。

- 鏡頭類型:清晰說明遠景、中景或特寫,並搭配合適的光照、淺景深與自然運動。

- 節奏:引導使用慢動作、延時攝影、停留鏡頭、長鏡頭、定格畫面或無縫轉場,以塑造節奏與氛圍。

- 環境氛圍:加入霧氣、薄霧、雨水、黃金時刻光線、反射效果和豐富的表面紋理等場景細節,讓畫面更具真實感。

- 風格:在提示詞開頭明確風格,如繪畫感、黑色電影、膠片風格、定格動畫、像素化邊緣、時尚大片或超現實風格。

- 光照:使用具體語言描述逆光、特定配色方案、柔和輪廓光、鏡頭光暈等光照細節。

- 情緒:聚焦刻畫單一主體的表演,透過清楚的面部表情和細微動作傳達情感。

- 聲音與音訊:提示角色使用不同語言說話或歌唱,並搭配明確的環境音描述。

最佳化 VRAM 使用量和圖像品質

作為前沿模型,LTX-2 為了提供高品質效果,通常需要佔用大量 VRAM。隨著解析度、畫格率、影片時長或採樣步數的提升,記憶體使用量也會隨之增加。

因此,ComfyUI 與 NVIDIA 合作最佳化了weight streaming 功能,當 GPU VRAM 不足時,可將工作流的部分內容卸載到系統記憶體中運行,不過相對地,效能也會下降。

依 GPU 型號和使用場景的不同,使用者可能需要對這些因素加以限制,以確保生成時間保持在合理範圍內。

LTX-2 雖然非常先進,但也和任何模型一樣,參數設定的微調都會對最終品質產生明顯影響。

若想瞭解如何在 RTX GPU 上最佳化 LTX-2,請參考用於 ComfyUI 的 LTX-2 快速入門指南。

使用 FLUX.2-Dev 與 LTX-2 建構自訂工作流程

若使用者需簡化在不同 ComfyUI 工作流之間來回切換,以及在本機尋找 FLUX.2-Dev 生成的圖片並插入 LTX-2 工作流中的過程,可將 FLUX.2-Dev 與 LTX-2 組合到一個新的工作流程中:

- 開啟已儲存的 FLUX.2-Dev 文字轉圖像工作流。

- 按住 Ctrl,並用滑鼠左鍵點擊 FLUX.2-Dev 文字轉圖像節點。

- 在 LTX-2「圖像轉影片」工作流中,使用 Ctrl+V 貼上該節點。

- 將滑鼠移到 FLUX.2-Dev 文字轉圖像節點的「IMAGE」介面點,按住左鍵並拖曳至「調整圖像/遮罩大小」介面點,系統將自動產生藍色連接線。

進階 3D 生成

在使用 FLUX.2 生成圖像,並以 LTX-2 生成影片之後,下一步便是加入 3D 引導。NVIDIA 的 3D 引導生成式 AI Blueprint 示範了如何利用 3D 場景與資產,在 RTX PC 上打造更可控、面向專業製作流程的圖像與影片管線,並提供現成的工作流,供使用者查看、調整和擴充。

此外,創作者也可以在 Stable Diffusion subreddit 和 ComfyUI Discord 上展示作品、與其他使用者交流,並取得幫助。

別錯過 : NVIDIA RTX AI PC 的最新進展

- NVIDIA @ CES 2026:NVIDIA 在 CES 發布的內容包括 NVIDIA RTX 加速 PC 端 4K AI 影片生成,以及 LTX-2 與 ComfyUI全方位升級。ComfyUI、LTX-2、Llama.cpp、Ollama、Hyperlink 等迎來全面 RTX 加速,解鎖 AI PC 上的影片、圖像與文字生成應用情境。

- Black Forest Labs 的多種 FLUX 2 版本:FLUX.2 [klein] 是一組緊湊、超高速的模型,支援圖像生成與編輯,並提供業界領先的圖像品質。這些模型可透過 NVFP4 與 NVFP8 加速,速度最高可提升 2.5 倍,並在 RTX GPU 上以高效能運行。

- Project G-Assist 更新:隨著全新的「推理模式」預設啟用,Project G-Assist 在準確性與智慧程度上獲得顯著提升,並具備同時執行多條指令的能力。G-Assist 現已可透過 iCUE 控制 G-SYNC 顯示器、CORSAIR 外設及 CORSAIR PC 元件的設定,涵蓋燈效、設定檔、效能與散熱等方面。對 Elgato Stream Deck 的支援也將很快推出,讓 G-Assist 更接近統一的 AI 介面,可用於調校和控制幾乎任何系統。全新基於 Cursor 的外掛建構器,讓 G-Assist 外掛程式開發者可借助 Cursor 的代理式程式設計環境,加速外掛開發流程。