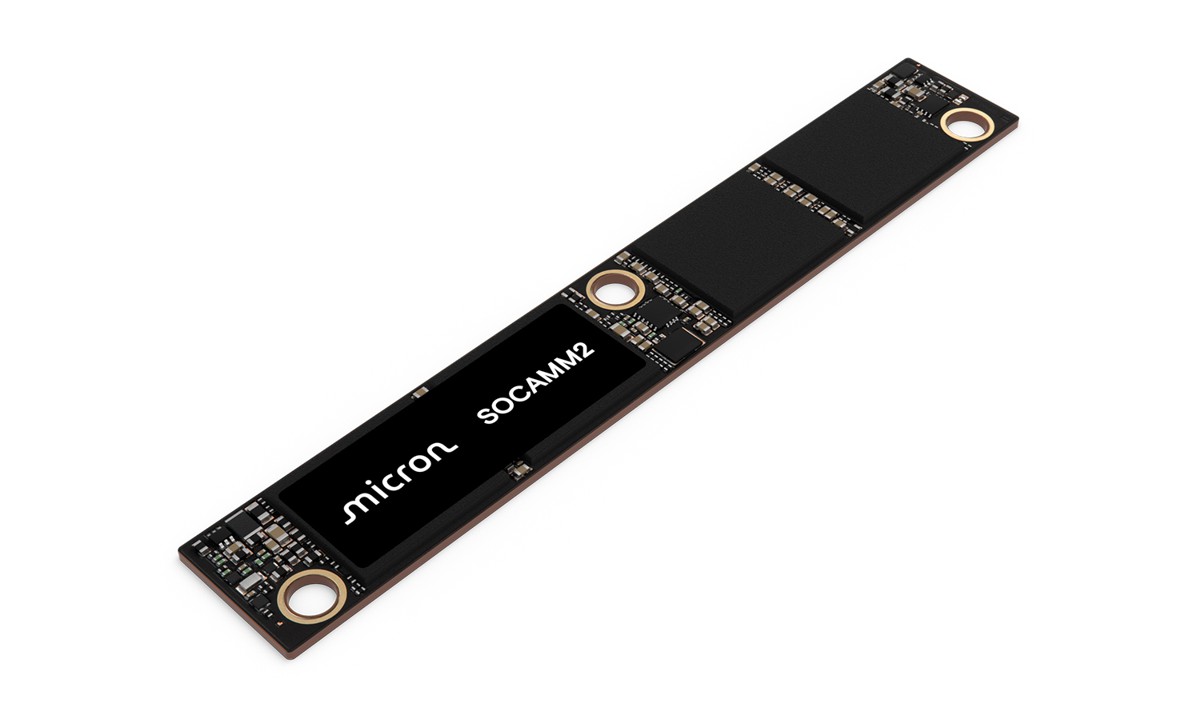

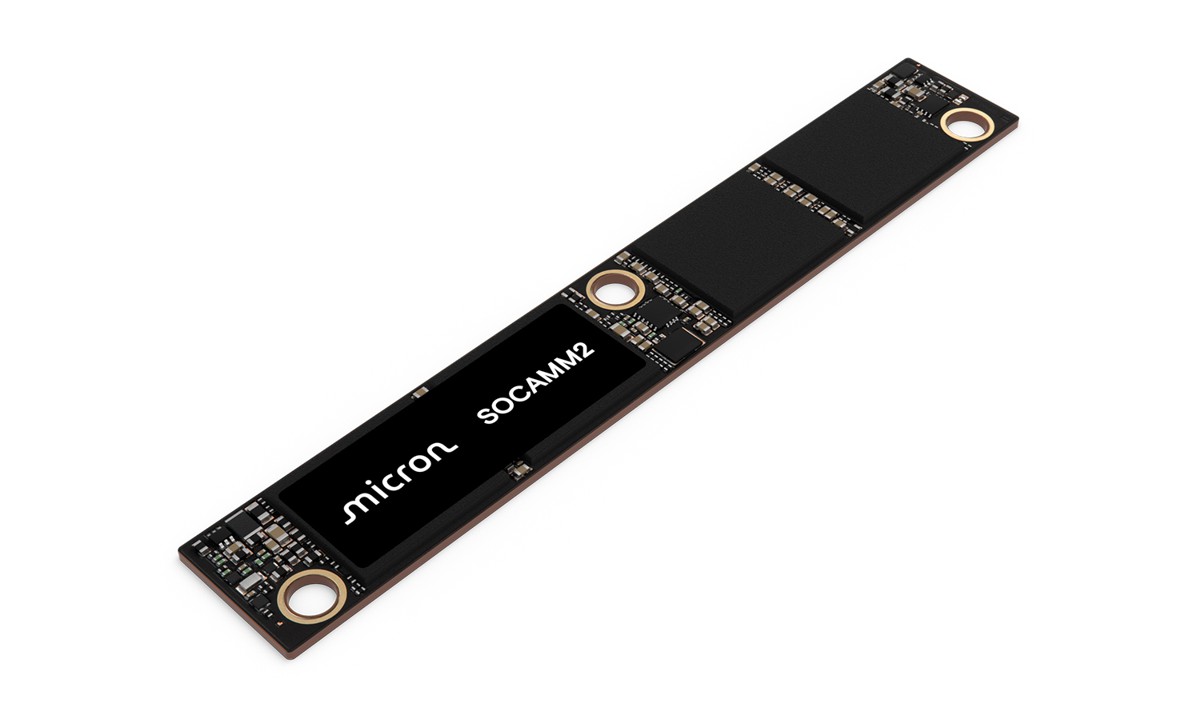

Micron 宣布推出容量達 256GB 的 LPDRAM SOCAMM2 模組,號稱為目前全球首款達到此容量等級的產品。相較於先前 192GB 的規格,新版本在單模組容量上再度提升,主打資料中心與 AI 基礎設施應用。

隨著 AI 工作負載規模持續擴大,記憶體瓶頸問題日益明顯,特別是在長上下文推論與 agentic 應用場景中,對容量與頻寬需求快速攀升。Micron 表示,新一代 SOCAMM2 將協助緩解 KV-cache 所帶來的延遲壓力,進一步降低長上下文運算的延遲。

NVIDIA 資料中心 CPU 產品負責人 Ian Finder 指出,256GB SOCAMM2 在提供大容量與高頻寬的同時,功耗低於傳統伺服器記憶體,有助於推動新一代 AI CPU 發展。

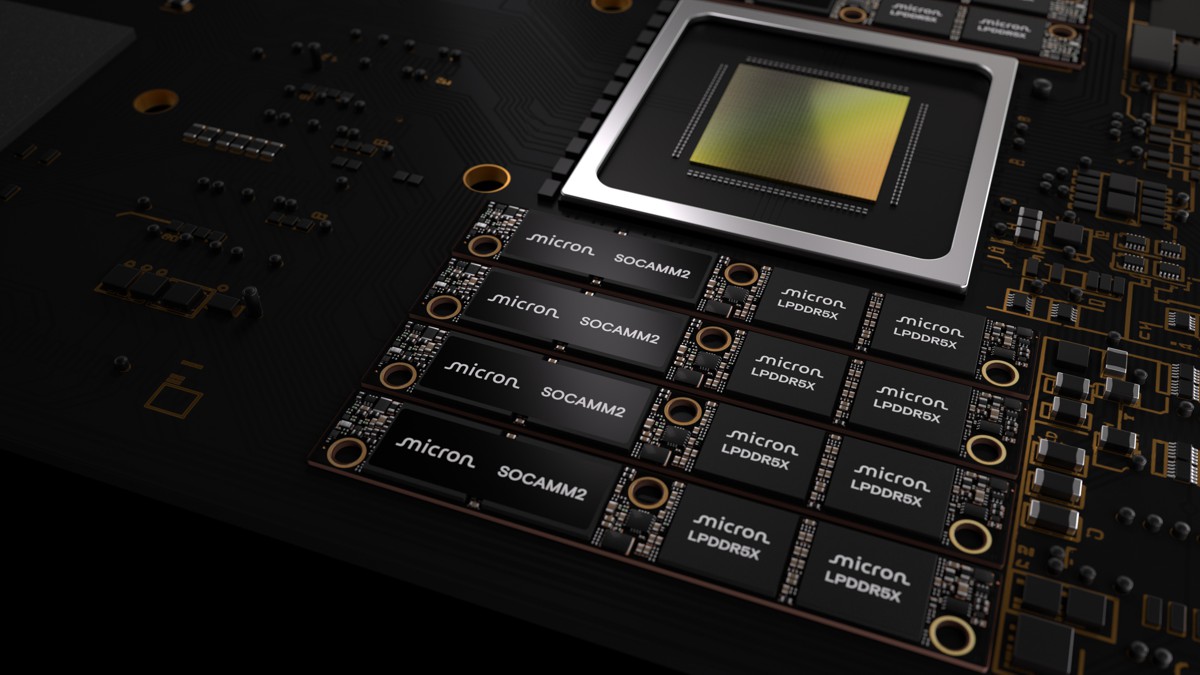

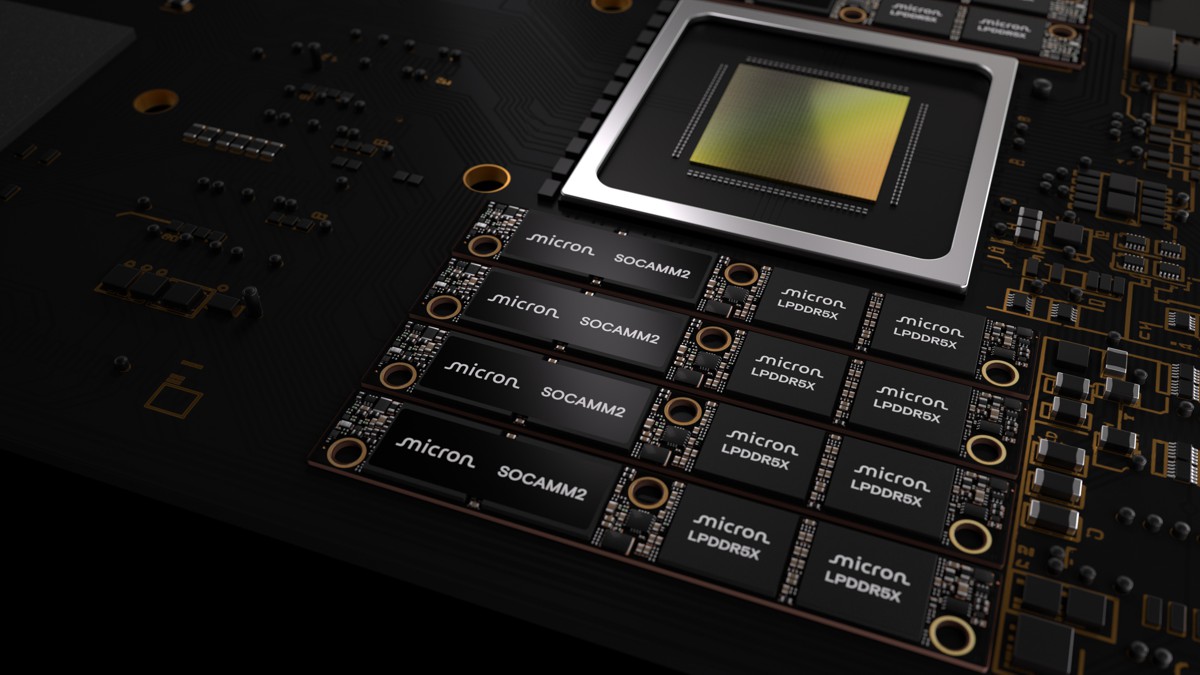

技術層面上,Micron 將單顆 LPDRAM 單晶片容量提升至 32GB,使單一 256GB 模組得以實現更高密度配置。在 8 通道 CPU 架構下,整體記憶體容量可達 2TB,讓 AI 伺服器在處理長上下文推論時更具彈性。

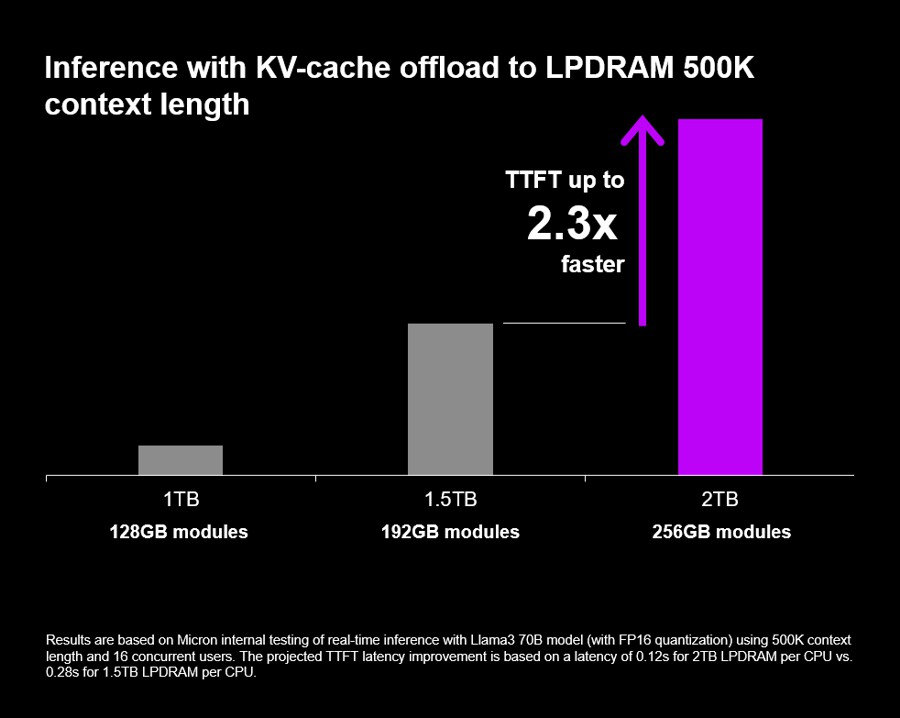

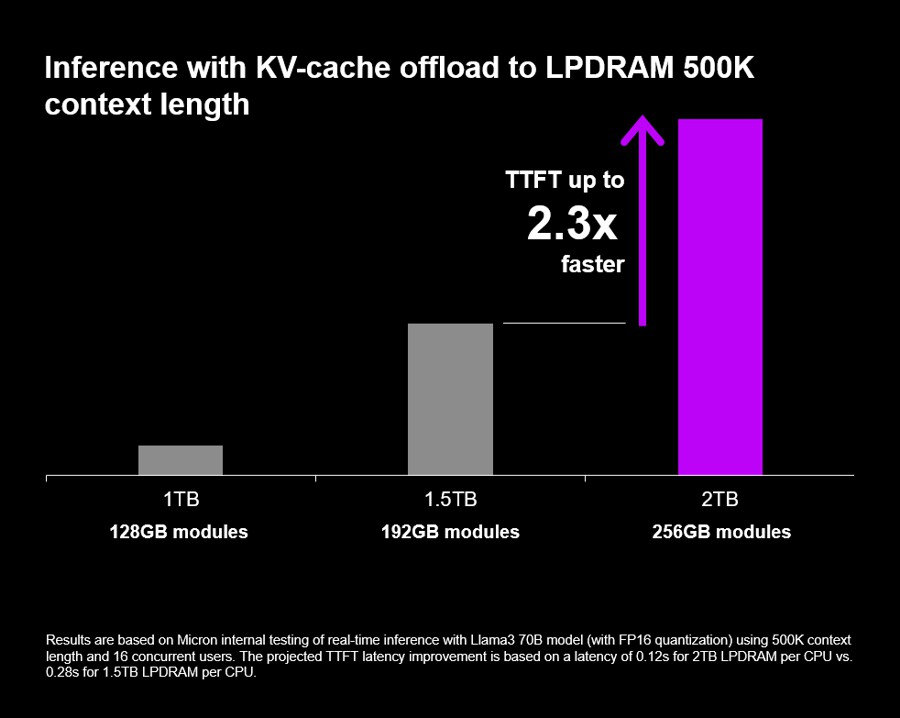

官方數據顯示,在長上下文推論場景中,新方案可將 TTFT(Time To First Token)提升約 2.3 倍,對強調即時回應與自主決策的 agentic 應用特別關鍵。

SOCAMM2 為 Micron 與 NVIDIA 合作開發的新型記憶體方案。先前資料指出,代號「Vera Rubin」的 AI 基礎設施產品,將成為首批採用該標準的解決方案之一。

在 AI 產業中,記憶體已成為影響延遲與上下文長度的關鍵資源。高容量 SOCAMM2 模組意味著單一系統將消耗更多 DRAM 產能,未來可能擠壓部分通用型產品(例如 GDDR7)的供應分配。

Micron 表示,256GB SOCAMM2 已開始出貨樣品給客戶,並將於 GTC 2026 期間公開展示。隨著 AI 基礎設施升級加速,高密度、低功耗記憶體解決方案的重要性預料將進一步提升。

隨著 AI 工作負載規模持續擴大,記憶體瓶頸問題日益明顯,特別是在長上下文推論與 agentic 應用場景中,對容量與頻寬需求快速攀升。Micron 表示,新一代 SOCAMM2 將協助緩解 KV-cache 所帶來的延遲壓力,進一步降低長上下文運算的延遲。

NVIDIA 資料中心 CPU 產品負責人 Ian Finder 指出,256GB SOCAMM2 在提供大容量與高頻寬的同時,功耗低於傳統伺服器記憶體,有助於推動新一代 AI CPU 發展。

技術層面上,Micron 將單顆 LPDRAM 單晶片容量提升至 32GB,使單一 256GB 模組得以實現更高密度配置。在 8 通道 CPU 架構下,整體記憶體容量可達 2TB,讓 AI 伺服器在處理長上下文推論時更具彈性。

官方數據顯示,在長上下文推論場景中,新方案可將 TTFT(Time To First Token)提升約 2.3 倍,對強調即時回應與自主決策的 agentic 應用特別關鍵。

SOCAMM2 為 Micron 與 NVIDIA 合作開發的新型記憶體方案。先前資料指出,代號「Vera Rubin」的 AI 基礎設施產品,將成為首批採用該標準的解決方案之一。

在 AI 產業中,記憶體已成為影響延遲與上下文長度的關鍵資源。高容量 SOCAMM2 模組意味著單一系統將消耗更多 DRAM 產能,未來可能擠壓部分通用型產品(例如 GDDR7)的供應分配。

Micron 表示,256GB SOCAMM2 已開始出貨樣品給客戶,並將於 GTC 2026 期間公開展示。隨著 AI 基礎設施升級加速,高密度、低功耗記憶體解決方案的重要性預料將進一步提升。