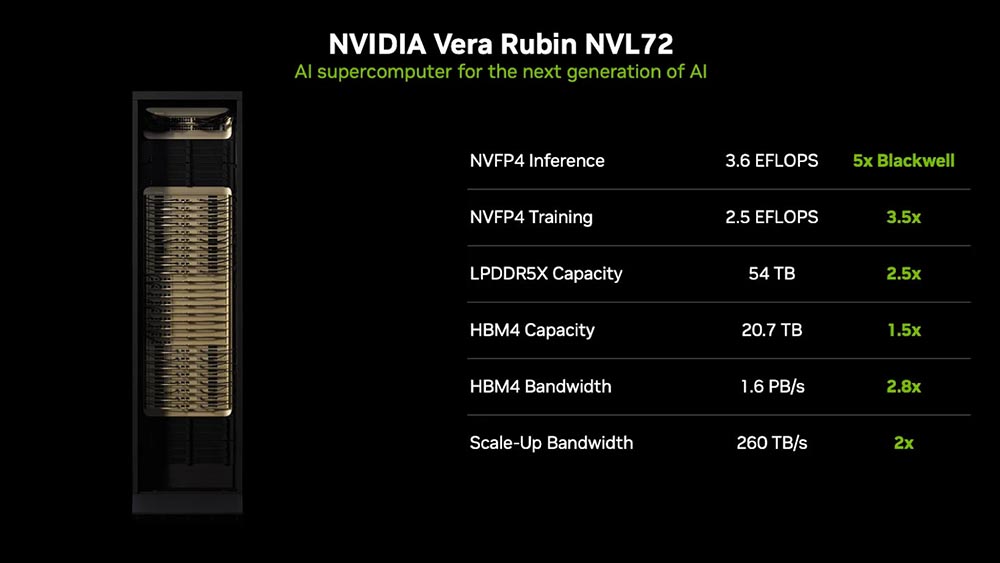

隨著 Agentic AI 應用快速成長,AI 伺服器對資料暫存與上下文記憶體的需求正急遽放大。Wcctech 外媒指出,NVIDIA 下一代 Vera Rubin AI 系統,可能單憑一己之力,就消耗掉全球 NAND 快閃記憶體產能的相當比例,進而加劇儲存市場的供應壓力。

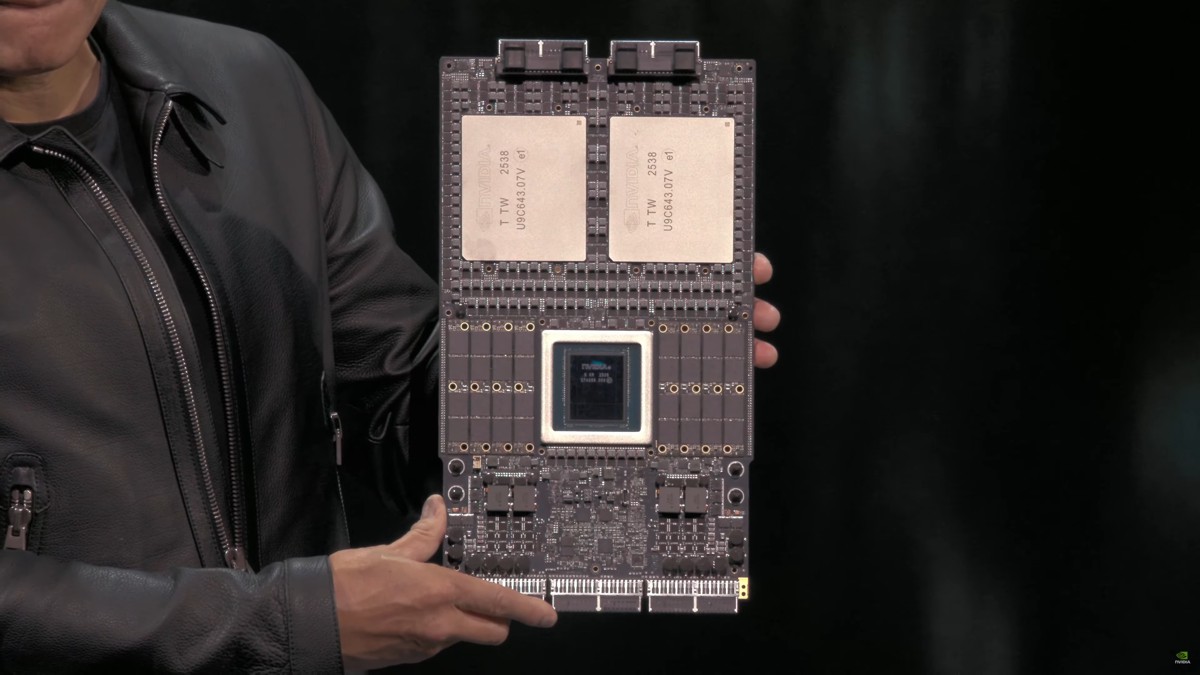

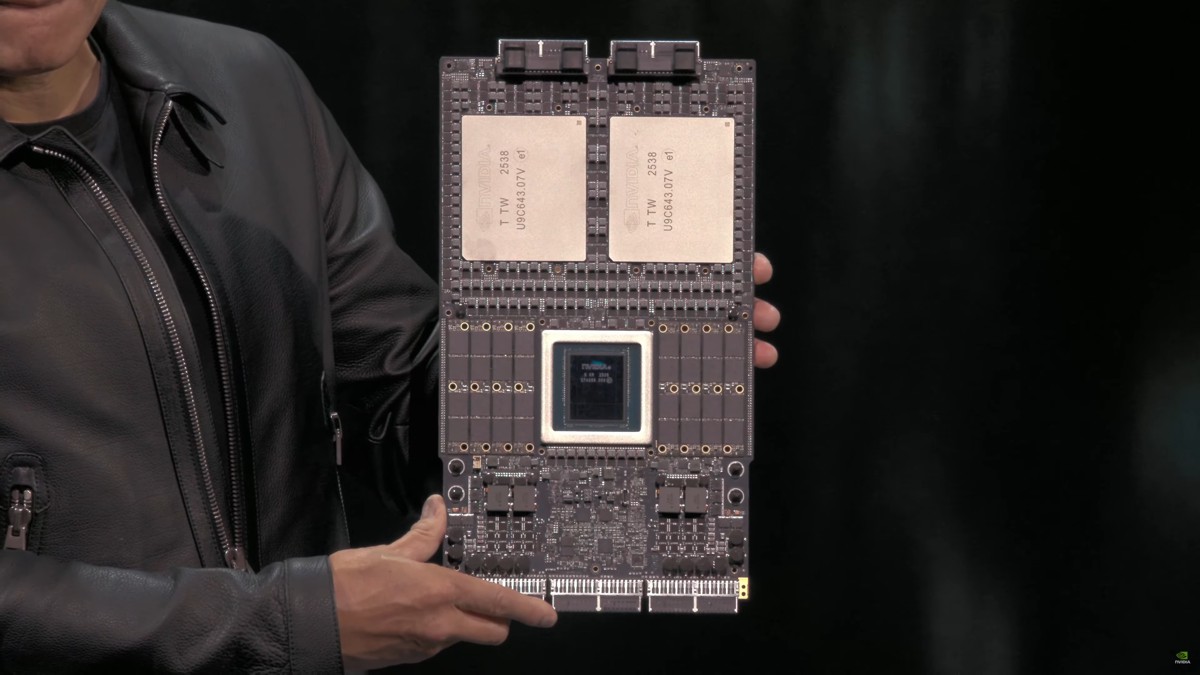

目前 AI 推論過程中,大量查詢會產生龐大的暫存資料(KV Cache),過去多半仰賴 HBM 進行存放,但隨著模型規模與推論需求不斷放大,HBM 的容量已逐漸成為瓶頸。對此,NVIDIA 在 CES 2026 宣布,將透過 BlueField-4 DPU 搭配全新的 Inference Memory Context Storage(ICMS) 架構,將部分推論暫存資料轉移至儲存層處理。

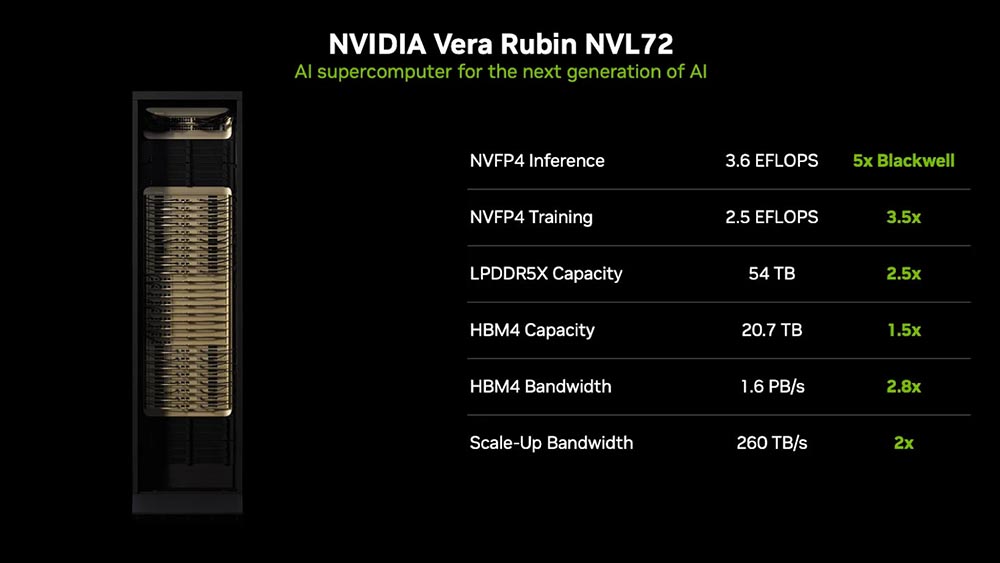

根據花旗(Citi)分析,每一套 Vera Rubin 系統中,每顆 GPU 可能搭配約 16TB 的 NAND SSD,在 NVL72 機櫃配置下,單一系統就需要高達 1,152TB 的 NAND 容量。若 Vera Rubin 在 2027 年出貨量擴大至 10 萬套,僅 NVIDIA 一家,就可能帶來 1.152 億 TB 的 NAND 需求,占全球 NAND 年產量預估的 9.3%。

分析指出,這樣的需求規模,甚至可能引發 NAND 產業尚未完全納入預期的供應衝擊。尤其在資料中心持續擴建、AI 推論需求爆發的背景下,NAND 市場本就處於偏緊狀態,NVIDIA 若進一步大舉吸納產能,勢必對整體供應結構造成影響。

業界也憂心,NAND 市場可能重演近年 DRAM 的走勢,高階應用優先搶走產能,價格與供貨彈性隨之降低。對一般消費者而言,未來在購買通用型 SSD 或儲存設備時,恐怕也將持續面臨價格上揚或供貨吃緊的現實。

目前 AI 推論過程中,大量查詢會產生龐大的暫存資料(KV Cache),過去多半仰賴 HBM 進行存放,但隨著模型規模與推論需求不斷放大,HBM 的容量已逐漸成為瓶頸。對此,NVIDIA 在 CES 2026 宣布,將透過 BlueField-4 DPU 搭配全新的 Inference Memory Context Storage(ICMS) 架構,將部分推論暫存資料轉移至儲存層處理。

根據花旗(Citi)分析,每一套 Vera Rubin 系統中,每顆 GPU 可能搭配約 16TB 的 NAND SSD,在 NVL72 機櫃配置下,單一系統就需要高達 1,152TB 的 NAND 容量。若 Vera Rubin 在 2027 年出貨量擴大至 10 萬套,僅 NVIDIA 一家,就可能帶來 1.152 億 TB 的 NAND 需求,占全球 NAND 年產量預估的 9.3%。

分析指出,這樣的需求規模,甚至可能引發 NAND 產業尚未完全納入預期的供應衝擊。尤其在資料中心持續擴建、AI 推論需求爆發的背景下,NAND 市場本就處於偏緊狀態,NVIDIA 若進一步大舉吸納產能,勢必對整體供應結構造成影響。

業界也憂心,NAND 市場可能重演近年 DRAM 的走勢,高階應用優先搶走產能,價格與供貨彈性隨之降低。對一般消費者而言,未來在購買通用型 SSD 或儲存設備時,恐怕也將持續面臨價格上揚或供貨吃緊的現實。